La regresión y la correlación son dos técnicas fundamentales en el análisis de datos. Ambas se utilizan para estudiar la relación entre variables y predecir valores futuros. En este artículo, exploraremos los mejores métodos numéricos para llevar a cabo análisis de regresión y correlación, específicamente en la versión 5.4.

¿Qué es la regresión?

La regresión es una técnica estadística que busca establecer una relación funcional entre una variable dependiente y una o más variables independientes. Su objetivo principal es predecir o estimar el valor de la variable dependiente en función de las variables independientes.

Existen varios métodos numéricos para realizar análisis de regresión, pero en esta guía nos enfocaremos en los mejores. Estos métodos incluyen la regresión lineal, la regresión polinómica, la regresión logística y la regresión de series de tiempo, entre otros.

Regresión lineal

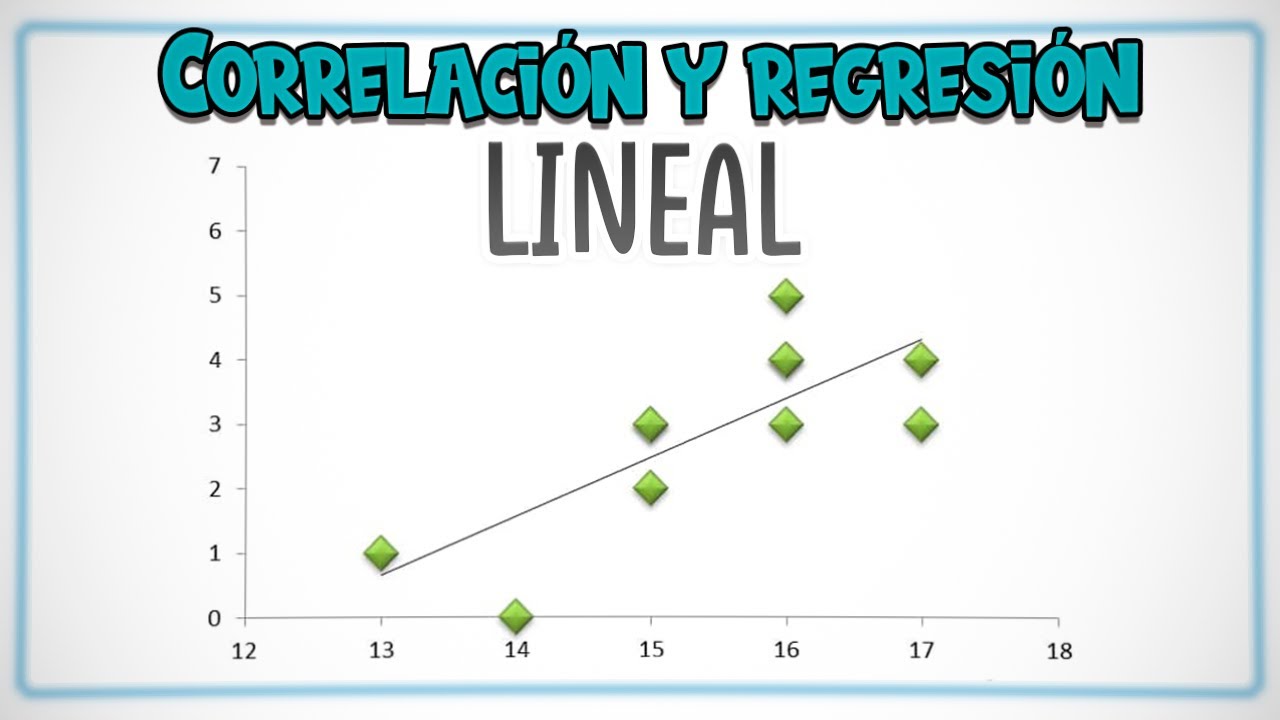

La regresión lineal es el método más sencillo y comúnmente utilizado para estimar la relación entre una variable dependiente y una o más variables independientes. Se basa en la suposición de que la relación entre estas variables puede ser modelada a través de una línea recta.

Para realizar una regresión lineal, se utiliza una fórmula matemática que calcula los coeficientes de la línea recta que mejor se ajusta a los datos. Estos coeficientes representan la pendiente y la intersección de la línea y se utilizan para predecir los valores de la variable dependiente.

Regresión polinómica

La regresión polinómica es una extensión de la regresión lineal que permite modelar relaciones no lineales entre variables. En lugar de una línea recta, se utilizan polinomios de grado superior para ajustar los datos.

La regresión polinómica es útil cuando se sospecha que la relación entre las variables no es lineal. Por ejemplo, si los datos muestran un patrón curvilíneo, puede ser necesario ajustar un polinomio cuadrático o cúbico para modelar adecuadamente la relación.

Regresión logística

A diferencia de la regresión lineal y polinómica, que se utilizan para variables continuas, la regresión logística se aplica cuando la variable dependiente es binaria o categórica. Se utiliza para predecir la probabilidad de que ocurra un evento, por ejemplo, si un cliente comprará un producto o no.

La regresión logística utiliza una función logística para modelar la relación entre las variables independientes y la probabilidad del evento en cuestión. Los coeficientes de la regresión logística se interpretan como las probabilidades de que una variable independiente tenga un impacto positivo o negativo en la variable dependiente.

Regresión de series de tiempo

La regresión de series de tiempo se utiliza para analizar y predecir series de datos que evolucionan a lo largo del tiempo. Este método tiene en cuenta tanto la relación entre la variable dependiente y las variables independientes, como la autocorrelación y la tendencia temporal.

Al igual que en los otros métodos de regresión, la regresión de series de tiempo utiliza coeficientes para estimar la relación entre las variables. Sin embargo, también considera factores específicos de las series de tiempo, como la estacionalidad y los valores anteriores de la variable dependiente.

Correlación y su importancia

La correlación es una medida estadística utilizada para evaluar la relación entre dos o más variables. Nos ayuda a determinar si existe una asociación entre las variables y la fuerza de esa asociación.

La correlación puede ser positiva, negativa o nula. Una correlación positiva significa que a medida que una variable aumenta, la otra también lo hace. En cambio, una correlación negativa indica que mientras una variable aumenta, la otra disminuye. Una correlación nula implica que no hay relación entre las variables.

Es importante tener en cuenta que la correlación no implica causalidad. Es decir, solo porque dos variables estén correlacionadas no significa necesariamente que una sea la causa de la otra.

Coeficiente de correlación de Pearson

El coeficiente de correlación de Pearson es el método más comúnmente utilizado para medir la correlación entre variables continuas. Este coeficiente varía entre -1 y 1, donde -1 representa una correlación negativa perfecta, 1 una correlación positiva perfecta y 0 una correlación nula.

El coeficiente de correlación de Pearson se calcula dividiendo la covarianza entre las variables por el producto de sus desviaciones estándar. Cuanto más cercano esté el coeficiente a -1 o 1, más fuerte será la correlación entre las variables.

Correlación de rangos de Spearman

La correlación de rangos de Spearman es un método no paramétrico utilizado para medir la correlación entre variables que no siguen una distribución normal. En lugar de utilizar los valores exactos de las variables, se clasifican en rangos y se utiliza la diferencia de rangos para calcular la correlación.

La correlación de rangos de Spearman también varía entre -1 y 1, donde -1 representa una correlación negativa perfecta, 1 una correlación positiva perfecta y 0 una correlación nula.

¿Cómo sé qué método de regresión usar?

La elección del método de regresión depende de la naturaleza de los datos y el tipo de relación que se espera entre las variables. Si se sospecha una relación lineal, la regresión lineal es la mejor opción. Si hay evidencia de una relación no lineal, se puede utilizar la regresión polinómica. Para variables binarias o categóricas, se recomienda la regresión logística.

¿Cómo interpretar el coeficiente de correlación de Pearson?

El coeficiente de correlación de Pearson es una medida de la fuerza y la dirección de la asociación entre dos variables continuas. Un valor cercano a 1 o -1 indica una correlación fuerte, mientras que un valor cercano a 0 indica una correlación débil. El signo del coeficiente (positivo o negativo) indica la dirección de la correlación (positiva o negativa).

¿La correlación implica causalidad?

No, la correlación no implica causalidad. Solo porque dos variables estén correlacionadas no significa que una sea la causa de la otra. Puede haber otros factores o variables ocultas que influyen en la relación entre las variables.

En resumen, los métodos numéricos para la regresión y correlación son herramientas fundamentales en el análisis de datos. La elección del método adecuado depende de la naturaleza de los datos y el tipo de relación que se espera. Tanto la regresión como la correlación nos ayudan a entender y predecir las relaciones entre variables, pero es importante recordar que la correlación no implica causalidad.